Gute Daten führen zu besseren Entscheidungen. Aber wenn Ihre Daten voller Fehler, Duplikate oder fehlender Informationen sind, können sie Fehler verursachen, Ressourcen verschwenden und Ihre Kunden frustrieren. An dieser Stelle kommen Data Quality Tools ins Spiel.

Diese Data Quality Tools helfen Ihnen, Ihre Daten zu bereinigen, zu prüfen und zu organisieren, damit sie genau, konsistent und einsatzbereit sind, ganz gleich, wie viele Daten Sie bearbeiten.

In diesem Artikel beschreiben und erläutern wir 7 der besten Data Quality Tools, die heute verfügbar sind. Sie erfahren, was jedes einzelne Tool kann, warum es nützlich ist und wo es in Ihrem Unternehmen eingesetzt werden kann. Außerdem geben wir Ihnen einige praktische Tipps, wie Sie das richtige Tool für Ihre Bedürfnisse auswählen, damit Sie Ihren Daten vertrauen und sie mit Zuversicht nutzen können.

Was sind Data Quality Tools?

Data Quality Tools sind Softwarelösungen, die dafür sorgen, dass Ihre Daten genau, konsistent und zuverlässig sind. Sie überprüfen Ihre Daten auf Fehler, beheben Probleme und sorgen dafür, dass alle Daten im richtigen Format vorliegen, damit sie in Ihrem Unternehmen leicht zu verwenden sind.

Einige ihrer Hauptfunktionen sind:

- Profiling: Scannen Ihrer Daten, um deren Struktur, Muster und mögliche Probleme zu verstehen.

- Bereinigen: Korrektur von Fehlern wie Tippfehlern, fehlenden Feldern oder veralteten Informationen.

- Validierung: Sicherstellen, dass die Daten den von Ihnen festgelegten Regeln entsprechen, z. B. gültige E-Mail-Formate oder korrekte Datumsbereiche.

- Deduplizierung: Auffinden und Entfernen von doppelten Datensätzen, so dass Sie dieselben Informationen nicht zweimal speichern müssen.

- Anreicherung: Hinzufügen zusätzlicher Details aus vertrauenswürdigen Quellen, um Ihre Daten vollständiger zu machen.

In der heutigen Welt ist das richtige Data Quality Tool ein wichtiger Bestandteil des modernen Datenmanagements.

Sie arbeiten oft mit Datenbanken, Data Warehouses, CRM-Plattformen und Analysetools zusammen, um Informationen in Topform zu halten. Indem sie die Datenqualität an der Quelle verbessern, helfen sie allen Abteilungen, vom Marketing bis zum Finanzwesen, mit präzisen, vertrauenswürdigen Erkenntnissen zu arbeiten.

Die 7 besten Data Quality Tools für bessere Forschungsdaten

Saubere, verlässliche Daten sind die Voraussetzung für genaue Forschungsergebnisse. Die folgenden Tools helfen Forschern dabei, sicherzustellen, dass ihre Datensätze genau, konsistent und bereit für die Analyse sind.

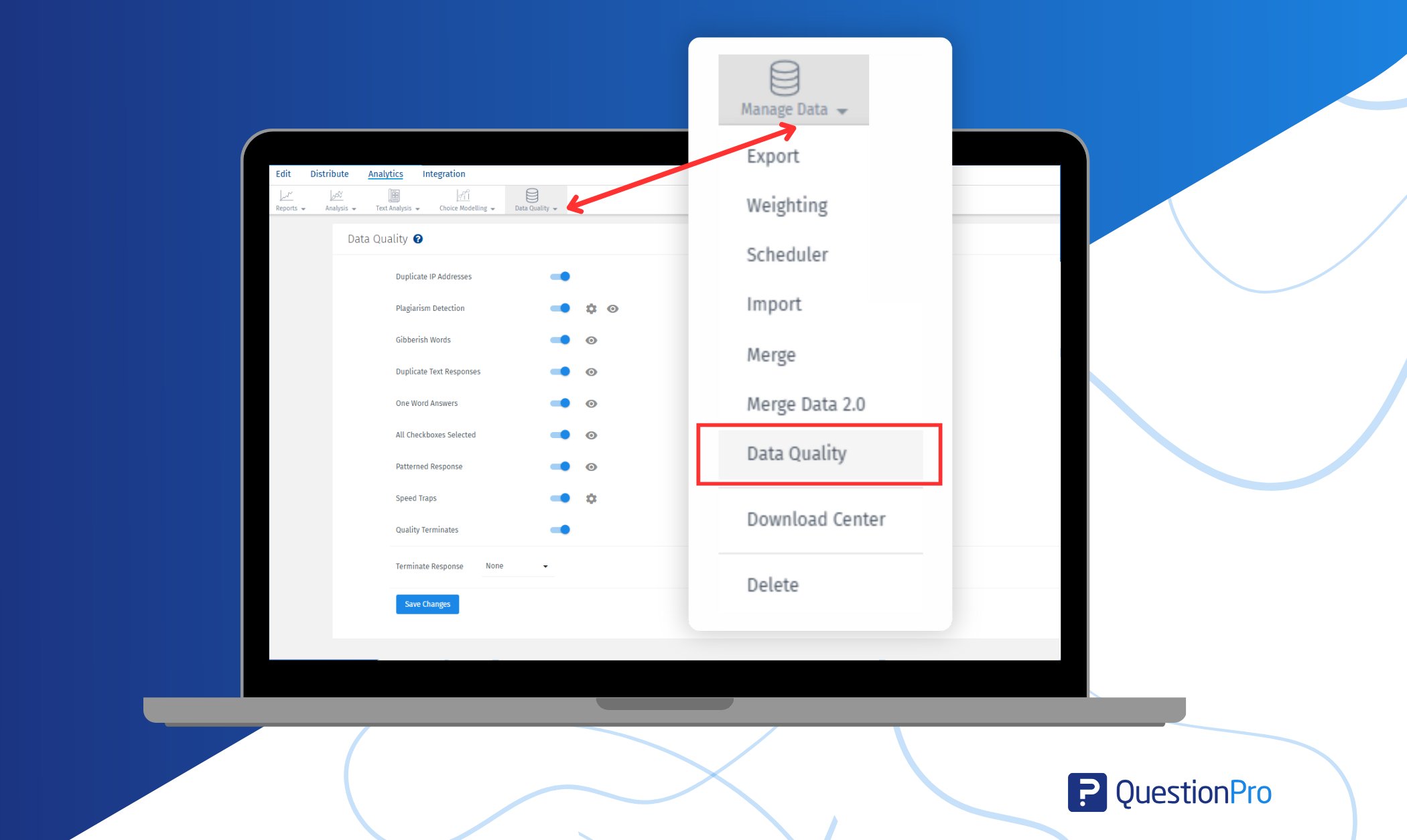

1. QuestionPro

QuestionPro ist eine leistungsstarke Umfrage- und Forschungsplattform mit integrierten Datenqualitätsfunktionen, einschließlich Betrugserkennung, Vermeidung von Duplikaten, Überprüfung von geografischen Standorten und benutzerdefinierter Validierung von Antworten. Sie wurde entwickelt, um sicherzustellen, dass Forscher nur mit sauberen, verifizierten Antworten arbeiten, bevor sie zur Analyse übergehen.

Merkmale:

- Datenbereinigungsfunktion für die Datenbereinigung.

- Vermeidung von Duplikaten für eindeutige, gültige Antworten.

- Benutzerdefinierte Regeln für die Validierung von Antworten, die den Forschungsanforderungen entsprechen.

- Erweiterte Analysen, einschließlich max-diff und NPS, für tiefe Einblicke in die gesammelten Daten.

- Optionen für die Verteilung von Umfragen über mehrere Kanäle.

- Identifiziert Kauderwelsch aus den Antworten.

- Integration mit gängigen CRM-, BI- und Analyseplattformen.

Einschränkung:

- Einige erweiterte Funktionen erfordern möglicherweise eine Schulung, um sie vollständig nutzen zu können.

Preisgestaltung:

- Kostenpflichtige Tarife beginnen bei $99 pro Monat, wobei für Unternehmen mit besonderen Anforderungen individuelle Preise verfügbar sind.

2. Ataccama EINS

Ataccama ONE vereint Datenqualität, Data Governance und Stammdatenverwaltung in einer KI-gestützten Plattform für Forschungsteams in Unternehmen.

Merkmale:

- Automatisierte Profilerstellung und Bereinigung von Daten.

- Stammdatenverwaltung für konsistente Datensätze.

- KI-unterstützte Erkennung von Anomalien.

- Tools zur Katalogisierung und Verwaltung von Daten.

- Überwachung der Datenqualität in Echtzeit.

Einschränkung:

- Für kleine oder mittelgroße Forschungsteams kann das zu viel sein.

- Die Implementierung kann eine erhebliche Einrichtungszeit erfordern.

Preisgestaltung:

- Individuelle Preise je nach Unternehmensgröße und Anwendungsfall.

3. Informatica Data Quality

Informatica Data Quality ist eine unternehmenstaugliche Lösung mit Automatisierung, Echtzeitüberwachung und KI-gestütztem Abgleich, um Forschungsdaten sauber und konsistent zu halten.

Merkmale:

- KI-gesteuerter Datenabgleich und Deduplizierung.

- Überwachung der Datenqualität in Echtzeit.

- Automatisierte Bereinigungs- und Validierungsregeln.

- Überprüfung und Standardisierung von Adressen.

Einschränkung:

- Der Preis kann für kleinere Teams hoch sein.

- Steilere Lernkurve für nicht-technische Benutzer.

Preisgestaltung:

- Individuelle Preise je nach Unternehmensgröße und Anforderungen.

4. IBM InfoSphere QualityStage

IBM InfoSphere QualityStage ist für seine leistungsstarken Abgleich- und Deduplizierungsfunktionen bekannt und eignet sich daher ideal für umfangreiche Forschungsdatenprojekte.

Merkmale:

- Datenstandardisierung und -validierung.

- Erweiterte Abgleichsalgorithmen für die Deduplizierung.

- Unterstützung für komplexe, quellenübergreifende Datenintegration.

- Tools zur Erstellung von Datenprofilen und zur Überwachung.

Einschränkung:

- Hohe Komplexität erfordert möglicherweise spezielles technisches Personal.

- Die Preise liegen am oberen Ende.

Preisgestaltung:

- Individuelle Preise für Unternehmen sind bei IBM erhältlich.

5. Talend Data Quality

Talend Data Quality bietet eine vielseitige Plattform für die Profilerstellung, Bereinigung und Anreicherung von Daten, mit starken Integrationsfunktionen für Forschungsdatenbanken und Datenpipelines.

Merkmale:

- Datenprofilierung zur Bewertung der Qualität und zur Identifizierung von Problemen.

- Bereinigung und Standardisierung für genaue Datensätze.

- Datenanreicherung aus externen Quellen.

- Erkennung und Zusammenführung von Duplikaten.

- Integration mit den Datenintegrations- und Cloud-Services von Talend.

Einschränkung:

- Für fortgeschrittene Konfigurationen ist möglicherweise technisches Fachwissen erforderlich.

- Die Verarbeitung großer Datenmengen kann hohe Systemressourcen erfordern.

Preisgestaltung:

- Talend bietet kostenpflichtige Enterprise-Pläne an, deren Preise sich nach Einsatz und Funktionsbedarf richten.

6. Trifacta Wrangler

Trifacta Wrangler bietet eine benutzerfreundliche Oberfläche für Datenverarbeitung, Profilerstellung und -aufbereitung, ohne dass umfangreiche Programmierkenntnisse erforderlich sind.

Merkmale:

- Interaktive Datenbereinigung und -umwandlung.

- Datenprofilierung und Qualitätskontrolle.

- Vorschläge zum maschinellen Lernen für Transformationsaufgaben.

- Integration mit Cloud Data Warehouses und Analyseplattformen.

- Unterstützung für große Datensätze und mehrere Dateiformate.

Einschränkung:

- Einige erweiterte Funktionen erfordern Premium-Tarife.

- Am besten geeignet für strukturierte Datensätze.

Preisgestaltung:

- Kostenpflichtige Preispläne sind auf Anfrage erhältlich.

7. OpenRefine

OpenRefine ist ein kostenloses Open-Source-Tool, das sich perfekt für das Bereinigen und Umwandeln unordentlicher Datensätze eignet, was es zu einem Favoriten für Forscher mit begrenztem Budget macht.

Merkmale:

- Datenexploration und Profilerstellung.

- Stapelverarbeitung und Transformation von Daten.

- Integration mit externen Datenquellen.

- Flexible Filter- und Facettierungsoptionen.

- Unterstützung für große Datenmengen.

Einschränkung:

- Begrenzte Automatisierungsfunktionen im Vergleich zu kostenpflichtigen Tools.

- Keine integrierte Echtzeit-Validierung oder Überwachung.

Preisgestaltung:

- Kostenlos und quelloffen.

Durch die Wahl des richtigen Data Quality Tools können Sie sicherstellen, dass Ihre Forschung von Anfang an auf genauen, vertrauenswürdigen Daten beruht.

Sie können sich auch über die besten Datenerfassungstools für die Forschung informieren.

Wie Sie das richtige Data Quality Tool auswählen

Die Wahl der richtigen Lösung beginnt damit, dass Sie Ihre Assets und Ihre Teams verstehen. Die besten Data Quality Tools beheben Probleme nicht nur im Nachhinein, sondern bieten eine kontinuierliche Überwachung der Daten, damit Sie immer mit guten Daten arbeiten.

1. Prüfen Sie den Umfang der Datenqualitätsprüfungen

Suchen Sie nach einer Plattform, die über Datenqualitätsprüfungen verfügt, um doppelte Einträge, unvollständige Datensätze und verdächtige Muster zu erkennen, bevor sie sich auf Ihre Ergebnisse auswirken. Funktionen wie die Erkennung von Duplikaten, die Validierung von Antworten und die Mustererkennung sind der Schlüssel zum frühzeitigen Erkennen von Datenqualitätsproblemen.

2. Priorisieren Sie Datenermittlung und Governance

Starke Discovery und Governance sorgen gemeinsam dafür, dass Ihre Daten im Laufe der Zeit korrekt und vertrauenswürdig bleiben.

Funktionen wie:

- Discovery zum Erkunden, Profilieren und Verstehen von Datensätzen in jeder Phase.

- Governance zur Wahrung von Konsistenz, Sicherheit und Compliance über alle Systeme hinweg.

Zusammen bedeutet dies, dass Ihre Daten genau, sicher und zuverlässig bleiben.

3. Verwenden Sie Daten Beobachtbarkeit und Tests

Ein gutes Tool sollte Daten beobachten können, damit Sie Anomalien in Echtzeit erkennen können. Automatisierte Tests und Validierungen stellen sicher, dass jede Antwort oder jeder Datensatz Ihren Anforderungen entspricht, wodurch sich der manuelle Überprüfungsaufwand für Ihr Team verringert.

4. Sorgen Sie für eine nahtlose Verbindung mit Ihrer Datenplattform

Die von Ihnen gewählte Lösung sollte sich in Ihre bestehende Plattform integrieren lassen, damit Ihre Teams Arbeitsabläufe ohne Unterbrechung verwalten können. Das bedeutet, dass die Überprüfung der Datenqualität Teil Ihres täglichen Arbeitsablaufs ist und nicht ein nachträglicher Einfall.

5. Fokus auf kontinuierliche Verbesserung

Ein gutes Tool sollte die Daten verbessern und durch die Automatisierung von Prüfungen Zeit sparen. Funktionen wie:

- Duplikaterkennung zum Entfernen von Duplikaten.

- Validierungsregeln, um sicherzustellen, dass die Antworten den Anforderungen entsprechen.

- Überprüfung der Antwort zur Bestätigung der Richtigkeit.

Die Integration in Ihre bestehende Plattform bedeutet nahtlose Arbeitsabläufe über Teams und Projekte hinweg. Durch die Kombination von Prävention und Intelligenz können Sie verhindern, dass schlechte Daten in Ihr System gelangen, und jede Entscheidung basiert auf genauen Informationen.

Bei der Wahl des richtigen Tools geht es um mehr als nur um das Ankreuzen von Kästchen. Es geht darum, eine Plattform zu finden, die Ihre Daten von der Erfassung bis zur Analyse aktiv schützt und aufwertet.

Wenn Ihre Lösung automatisierte Prävention, Echtzeitüberwachung und verwertbare Erkenntnisse vereint, können Ihre Teams mit der Gewissheit arbeiten, dass jede Entscheidung auf guten Daten beruht.

Der Vergleich von Data Quality Tools hilft Ihnen bei der Auswahl des richtigen Tools

Bei der Vielzahl der verfügbaren Data Quality Tools kann es schwierig sein, das richtige für Ihre Bedürfnisse zu finden.

| Werkzeuge | Hauptmerkmale | Nachteile | G2 Bewertungen (von 5) | Preisgestaltung |

| QuestionPro | Datenbereinigung, Vermeidung von Duplikaten, benutzerdefinierte Antwortvalidierung, erweiterte Analysen, Verteilung über mehrere Kanäle, Erkennung von Kauderwelsch, CRM/BI-Integration. | Für einige erweiterte Funktionen ist möglicherweise eine Schulung erforderlich | 4.5 | Beginnt bei $99/Monat. |

| Talend Data Quality | Datenprofilierung, -bereinigung, -standardisierung, -anreicherung, Erkennung/Zusammenführung von Duplikaten und Integration mit Talend Services. | Erfordert technisches Fachwissen, ressourcenintensiv für große Datenmengen | 4.3 | Individuelle Preise für Unternehmen. |

| Informatica Data Quality | KI-gesteuerter Abgleich/Duplizierung, Echtzeitüberwachung, automatische Bereinigung/Validierung und Adressüberprüfung. | Hohe Kosten, steile Lernkurve | 4.5 | Benutzerdefinierte Preise. |

| OpenRefine | Datenexploration, Profilerstellung, Batch-Transformation, Integration externer Daten, flexible Filterung und Unterstützung für große Datenmengen. | Begrenzte Automatisierung, keine Echtzeit-Validierung | 4.6 | Kostenlos und quelloffen. |

| Ataccama ONE | Automatisierte Profilerstellung/Bereinigung, MDM, KI-Erkennung von Anomalien, Datenkatalogisierung/Governance und Echtzeitüberwachung. | Overkill für kleinere Teams, lange Einrichtung | 4.2 | Benutzerdefinierte Preise. |

| IBM InfoSphere QualityStage | Standardisierung, erweiterter Abgleich, Deduplizierung, Profiling und Integration mehrerer Quellen. | Komplexe Einrichtung, hohe Kosten | 4.1 | Individuelle Preise für Unternehmen. |

| Trifacta Wrangler | Interaktive Datenbereinigung/-umwandlung, Profilerstellung, Qualitätsprüfungen, ML-Transformationsvorschläge, Cloud-Integration und Unterstützung großer Datensätze. | Premium-Funktionen erfordern höherstufige Tarife | 4.3 | Bezahlte Preise auf Anfrage |

Welches Tool für Sie am besten geeignet ist, hängt von Ihren Daten-Workflows, der Größe Ihres Teams und dem Grad der Automatisierung und Integration ab, den Sie benötigen.

Ganz gleich, ob Sie eine Komplettlösung mit fortschrittlichen Datenqualitätsprüfungen oder eine spezialisierte Plattform für eine umfangreiche Datenvalidierung suchen, dieser Vergleich kann Ihnen helfen, eine sichere und fundierte Entscheidung zu treffen.

Vorteile der Verwendung von Data Quality Tools

Der Einsatz der richtigen Data Quality Tools kann einen großen Einfluss darauf haben, wie Ihr Unternehmen arbeitet und welche Ergebnisse Sie erzielen. Hier sind einige der wichtigsten Vorteile:

- Verbesserte Entscheidungsgenauigkeit: Zuverlässige, gut strukturierte Daten helfen Teams, sichere, faktenbasierte Entscheidungen zu treffen.

- Gesteigerte betriebliche Effizienz: Automatisierte Datenqualitätsprüfungen sparen Zeit, reduzieren manuelle Fehler und rationalisieren Arbeitsabläufe, was letztlich die Gesamtproduktivität erhöht.

- Bessere Einhaltung von Vorschriften und Risikomanagement: Eine starke Datenverwaltung stellt sicher, dass Sie die gesetzlichen Vorschriften einhalten und kostspielige Fehler vermeiden.

- Höhere Kundenzufriedenheit und Personalisierung: Genaue, aktuelle Informationen ermöglichen maßgeschneiderte Interaktionen und bessere Kundenerlebnisse.

Wenn die Daten sauber, konsistent und vertrauenswürdig sind, kann jeder Teil Ihres Unternehmens, von der Strategie bis zur Kundenbindung, sein Bestes geben.

Warum QuestionPro die beste Wahl für die Aufrechterhaltung der Datenqualität sein kann

Wenn es um die Sicherstellung qualitativ hochwertiger Daten geht, zeichnet sich QuestionPro durch die Kombination leistungsstarker Umfrage- und Forschungsfunktionen mit integrierten Datenqualitätsprüfungen aus, die Probleme verhindern, bevor sie sich auf die Ergebnisse auswirken.

Es ist nicht nur ein Tool zur Datenerfassung, sondern eine umfassende Lösung zur Überwachung der Datenqualität, zur Verbesserung der Datenzuverlässigkeit und zur Aufrechterhaltung der Sauberkeit Ihrer Datenpipeline von Anfang bis Ende.

Zu den wichtigsten Stärken gehören:

- Erkennung von doppelten IP-Adressen und Vermeidung von doppelten Textantworten, um wiederholte oder betrügerische Übermittlungen zu vermeiden.

- Radarfallen und Erkennung von Reaktionsmustern zur Kennzeichnung von Eingaben mit geringem Aufwand oder automatischen Eingaben.

- Erkennung von Kauderwelsch und Ein-Wort-Antworten, um die Qualität der Antworten zu erhalten.

- Individuelle Antwortvalidierung, um sicherzustellen, dass die Daten Ihren spezifischen Forschungsanforderungen entsprechen.

- Standardisierungstools, um Formate für eine einfachere Analyse konsistent zu halten.

- Aktualitätsprüfungen, um sicherzustellen, dass Sie mit den aktuellsten Informationen arbeiten.

- Erweiterte Analysen wie MaxDiff und NPS, um tiefe Einblicke aus Ihren gesammelten Daten zu gewinnen.

- Integration mit gängigen CRM-, BI- und Analyseplattformen, um Arbeitsabläufe zu optimieren und Ihre Daten in Verbindung zu halten.

- Sparen Sie Zeit mit flexibler Logik und erweiterten Filtern, mit denen Sie Antworten schnell verfeinern, segmentieren und validieren können, um bessere Entscheidungen zu treffen.

Da QuestionPro in gängige CRM-, BI- und Analyseplattformen integriert werden kann, können Datenexperten problemlos von der Datenermittlung zur Analyse übergehen, ohne dabei an Qualität zu verlieren. Dies macht es zu einer zuverlässigen Wahl für Unternehmen, die Daten standardisieren, sensible Daten schützen und eine solide Grundlage für die Entscheidungsfindung schaffen möchten.

Bewährte Praktiken für die Aufrechterhaltung einer hohen Datenqualität

Um Datenbestände sauber und zuverlässig zu halten, bedarf es einer Kombination aus den richtigen Tools, Prozessen und der Abstimmung im Team. Im Folgenden finden Sie einige Best Practices, die Ihnen helfen, die Datenqualität zu erhalten und die Datenqualitätssicherung in Ihrem Unternehmen zu unterstützen:

- Kontinuierliche Überwachung und Audits: Regelmäßige Datenüberwachung hilft dabei, Probleme frühzeitig zu erkennen und zu beheben, um die Datenintegrität und Datensicherheit zu gewährleisten.

- Klare Richtlinien für die Datenverwaltung: Gut definierte Regeln leiten Datenbenutzer bei der Verwaltung, Speicherung und dem Zugriff auf Informationen im modernen Datenstapel.

- Abteilungsübergreifende Zusammenarbeit: Die Zusammenarbeit zwischen technischen und geschäftlichen Teams verbessert die Datenqualitätsprozesse und stellt sicher, dass jeder die Bemühungen um Datenqualität unterstützen kann.

- Regelmäßige Datenprüfung: Testen Sie die Daten regelmäßig, um ihre Genauigkeit zu überprüfen, Inkonsistenzen zu erkennen und die Datenqualität zu verbessern, bevor sie in das Data Warehouse gelangen.

- Datenvalidierung und Sicherheitsprüfungen: Führen Sie Kontrollen ein, um die Richtigkeit der Daten zu gewährleisten, sensible Daten zu schützen und die Einhaltung gesetzlicher Vorschriften sicherzustellen.

Wenn Sie diese Praktiken befolgen, können Unternehmen einen nachhaltigen Rahmen für die Sicherung der Datenqualität schaffen, der dafür sorgt, dass die Informationen korrekt, sicher und entscheidungsreif sind.

Prüfen Sie auch: Datengenauigkeit vs. Datenintegrität

Fazit

Datenqualität ist nicht nur ein technisches Kästchen, das man ankreuzen muss, sondern die Grundlage für verlässliche Erkenntnisse und sichere Entscheidungen. In diesem Artikel stellen wir Ihnen die 7 besten Datenqualitätstools vor und zeigen Ihnen, wie Sie das richtige Tool für Ihre Forschung auswählen.

Datenqualität erfordert kontinuierliche Bemühungen mit den richtigen Tools und Prozessen. QuestionPro verfügt über eine Reihe von Funktionen zur Erkennung von Duplikaten, zur Validierung von Antworten und zur Identifizierung verdächtiger Muster, bevor diese die Ergebnisse beeinflussen.

Mit fortschrittlichen Tests, Echtzeitüberwachung und integrationsfreundlichen Workflows hilft QuestionPro Unternehmen, die Integrität ihrer Daten zu schützen, Vertrauen aufzubauen und das Beste aus ihrer Datenverwaltung herauszuholen.

Häufig gestellte Fragen (FAQs)

Antwort: Qualitativ minderwertige Daten können zu fehlerhaften Erkenntnissen, verschwendeten Ressourcen, falschen strategischen Entscheidungen und beschädigtem Kundenvertrauen führen.

Antwort: Vollständigkeit bedeutet, dass alle erforderlichen Informationen vorhanden sind, während Konsistenz bedeutet, dass die Daten in allen Systemen demselben Format, denselben Regeln und Standards folgen.

Antwort: Data Governance ist der Rahmen von Richtlinien, Prozessen und Standards, die sicherstellen, dass Daten ordnungsgemäß verwaltet werden und Fehler und Inkonsistenzen reduziert werden.

Antwort: Die Automatisierung kann doppelte Einträge erkennen, unvollständige Antworten kennzeichnen, Formate validieren und verdächtige Muster viel schneller erkennen als manuelle Prüfungen.

Antwort: QuestionPro bietet eine integrierte Datenvalidierung, Duplikaterkennung und Antwortmusterprüfung und hilft Unternehmen, die Datenintegrität zu schützen, bevor die Analyse beginnt.